目次

- 1 データが証明する従来型認証の限界と、次世代認証「パスキー」がもたらす事業価値の定量的分析

- 2 多要素認証(MFA)のROI最大化戦略:データに基づき、セキュリティとUXのトレードオフを解消

- 3 ネットワークポリシーの技術的負債と運用リスクの定量化:データ主導のNSPM戦略によるROI最大化

- 4 データ主導で解き明かす欧州CRA対応の最適解:リスクの定量化と戦略的アプローチ

- 5 データドリブン・サプライチェーンリスク管理への変革:リスクの定量化と評価プロセスの最適化

- 6 中小企業のためのデータドリブン・セキュリティ投資戦略:Microsoft 365 Business PremiumのROIを最大化する方法

データが証明する従来型認証の限界と、次世代認証「パスキー」がもたらす事業価値の定量的分析

1. 経営課題として顕在化した認証基盤の脆弱性

2025年初頭に発生した大規模な証券口座不正利用事案は、個別のインシデントに留まらず、金融機関における認証基盤の構造的脆弱性が、顧客資産とブランド価値を直接的に毀損する重大な経営課題であることを示しました。

データが示す脅威の本質は、フィッシング攻撃の「成功率」と「攻撃コスト」の劇的な変化にあります。生成AIによる自然な文面作成や、「Phishing-as-a-Service」と呼ばれる攻撃のプラットフォーム化は、攻撃者側の投資対効果(ROI)を著しく向上させました。これにより、従来のパスワードやSMS認証情報といった「知識情報」や「所持情報」を詐取する攻撃の量が爆発的に増加し、確率論的に認証突破のリスクは過去にないレベルまで高まっています。

2. なぜパスキーは攻撃を「不能」にするのか:データとアーキテクチャによる証明

この状況下で、新たな認証のデファクトスタンダードとして注目されるのが「パスキー」です。その有効性は、情緒的な期待ではなく、客観的なデータによって裏付けられています。

統計的実績: 2024年時点で全世界150億を超えるアカウントがパスキーを利用しており、これに対するフィッシング攻撃による大規模な認証突破事例は皆無です。これは、攻撃の成功確率を限りなくゼロに近づけることを統計的に証明しています。

技術的優位性: パスキーは、デバイス内の安全な領域(セキュアエレメント)で生成された秘密鍵と公開鍵のペアを用いるFIDO規格に準拠しています。認証時には、利用者が詐取され得ない生体情報等で秘密鍵を呼び出し、署名を作成します。サーバー側は公開鍵でその署名を検証するだけであり、認証情報そのものがネットワーク上を流れません。このアーキテクチャが、中間者攻撃を含むあらゆるフィッシングを原理的に無効化します。

政府や金融庁がフィッシング対策の切り札としてパスキーを推奨し、メガバンクが先行して導入を進めている事実は、この技術的・統計的優位性に基づいた合理的な経営判断です。

3. セキュリティ投資から事業価値創造へ:パスキー導入のROI

パスキーの導入は、単なる防御コストではありません。顧客体験(UX)の向上とオペレーションコストの削減を通じて、事業価値を創出する戦略的投資と位置づけるべきです。

実際に、先行導入した金融機関からは、以下のような定量的な効果が報告されています。

顧客エンゲージメント向上: パスワード忘れや入力ミスによるログイン失敗が激減し、「ログイン成功率が99%に向上」。これは、顧客満足度の向上とサービス離反率の低下に直結するKPIです。

オペレーションコスト削減: ログインに関する問い合わせ件数が大幅に減少し、「コールセンターの運用コスト削減」を実現。削減されたコストは、より付加価値の高い業務へ再配分が可能です。

このように、パスキーはセキュリティの強化と、UX向上によるビジネス成長、そしてコスト削減を同時に実現する、極めて投資対効果の高いソリューションです。

4. 金融機関向け:パスキー導入の意思決定を加速する

本セミナーは、金融機関および関連事業者の経営層、システム企画、セキュリティ責任者を対象とし、パスキー導入に関する具体的な意思決定に必要なデータと知見を提供します。

パスワードやSMS認証など既存の認証方式とのセキュリティレベル、UX、実装・運用コストを定量的に比較分析。さらに、実際の導入事例に基づき、貴社における投資対効果(ROI)の試算モデルや、低コストで導入を実現する具体的なソリューションを提示します。セキュリティリスクの抜本的解決と事業成長の両立に向けた、データに基づく次の一手を共に検討します。

多要素認証(MFA)のROI最大化戦略:データに基づき、セキュリティとUXのトレードオフを解消

1. 経営課題としての多要素認証(MFA)戦略

クラウド利用の常態化とワークスタイルの多様化を背景に、ID/パスワードのみに依存する認証モデルは、事業継続性を脅かすリスクとして明確に認識されています。各省庁のセキュリティガイドラインが多要素認証(MFA)実装を必須要件としている事実は、認証基盤の高度化が、もはや選択ではなく、企業の社会的責任とガバナンスの問題であることを示しています。

現在の経営課題は「MFAを導入するか否か」という段階にはありません。「どの認証方式に投資すれば、セキュリティ強度、ユーザー体験(UX)、総所有コスト(TCO)のバランスを最適化し、投資対効果(ROI)を最大化できるか」という、高度な経営判断そのものへと移行しています。

2. MFA選定における「分析の罠」:なぜ最適解は見えにくいのか

MFAの必要性が高まる一方、市場には多様な認証方式(SMS、認証アプリ、ハードウェアトークン、デバイス証明書など)が混在し、意思決定を著しく困難にしています。この選定の難しさの本質は、各方式が持つ特性のトレードオフ関係にあります。

セキュリティ強度 vs ユーザー体験(UX): 一般に、セキュリティ強度を高めるほど認証プロセスは煩雑になり、ログイン成功率の低下や生産性の阻害といったUXの劣化を招きます。

初期コスト vs 運用コスト: ハードウェアトークンのように初期コストが高いもの、あるいはSMS認証のように運用(通信)コストがかかるものなど、TCOの観点での比較分析が不可欠です。ヘルプデスクへの問い合わせ件数といった、見えにくい運用負荷もデータとして捉える必要があります。

これらの多次元にわたる評価軸を総合的かつ定量的に評価せず、安易な選定を行うことは、「セキュリティKPIは向上しないまま、運用コストと従業員の不満だけが増大する」という投資の失敗に直結します。

3. データドリブンな選定フレームワークと最適解

この複雑な最適化問題を解決する唯一の方法は、データに基づいた評価フレームワークを適用することです。本稿では、最新のガイドラインが求める「フィッシング耐性」を最高レベルで満たしつつ、UXの劣化を回避する構成として、「許可されたデバイス」そのものを認証要素とするアプローチを提示します。

具体的には、ID管理基盤ツールとクライアント証明書「サイバートラスト デバイスID」の連携です。この構成がなぜ有力な解となり得るのか、その論理は明確です。

フィッシング耐性の最大化: 認証情報を盗むフィッシングとは異なり、そもそも証明書がインストールされた正規のデバイス以外からのアクセスをシステムレベルで拒絶するため、不正アクセスのリスクを原理的に排除します。

UXの飛躍的向上: 利用者は一度デバイス登録を済ませれば、日常のアクセス時にパスワード以外の追加アクションを求められません。これにより、セキュリティと利便性のトレードオフを解消します。

4. 認証戦略の意思決定を加速する

本セミナーでは、このデータドリブンなMFA選定フレームワークを詳説します。数ある認証方式を、セキュリティ強度、UX、TCO、そしてガイドライン適合性という軸で定量的に評価・比較し、貴社のユースケースにおける最適解を導出するための思考プロセスを提供します。

なぜ「デバイス認証」を軸とした構成が、多くの企業で選ばれているのか。その導入効果を具体的な事例データと共に解説し、貴社の認証戦略におけるROIを最大化するための、具体的な知見をお持ち帰りいただきます。

ネットワークポリシーの技術的負債と運用リスクの定量化:データ主導のNSPM戦略によるROI最大化

1. 問題の再定義:管理オブジェクトの指数関数的増加と手動運用の限界

リモートワークとクラウドの普及は、企業ネットワークをオンプレミス、マルチクラウドが混在する複雑なハイブリッド環境へと不可逆的に変化させました。この変化の本質は、管理すべきファイアウォール(FW)ルール、アクセスコントロールリスト(ACL)、ルーティング設定といった構成オブジェクト数が指数関数的に増加している点にあります。

一方で、これらのポリシーレビューや変更作業を人手に依存する従来型の運用体制では、その処理能力は線形的にしか向上しません。この**「管理対象の増加ペース」と「管理能力」との間に生じるギャップ**こそが、設定ミス(ミスコンフィグ)の発生確率を必然的に高め、サイバー攻撃の侵入経路となる重大なリスクの根源となっています。特に、複数ベンダー製品が混在する環境では、ポリシーの標準化が困難となり、このリスクはさらに増幅されます。

2. 運用課題の構造分析:定量化すべき4つのリスク領域

手動運用に起因する課題は、以下の4つのリスク領域として構造的に分析できます。

ポリシー品質の劣化(技術的負債): 意図せず通信をブロックする「シャドウルール」や、使用されていない「未使用ルール」、重複した「冗長ルール」といった技術的負債が蓄積します。これらは、パフォーマンス低下や潜在的なセキュリティホールとなり、定量的な評価が不可欠です。

運用プロセスの非効率化: 手動でのポリシーレビューや変更履歴の追跡は、膨大な工数を消費するだけでなく、その正確性をデータで証明することが困難です。これは、運用コストを直接的に押し上げる要因となります。

コンプライアンス違反リスク: NISTやPCI-DSS、さらには企業独自の基準に対する準拠状況を、手動で継続的にアセスメントし、監査レポートを作成するプロセスは非効率かつ高コストです。監査での指摘は、事業機会の損失に直結するリスクを伴います。

属人化による運用継続リスク: 特定のベンダー製品や複雑な設定に関する知識が、一部の担当者に集中(属人化)することで、その人材の異動や退職が事業継続性を脅かすボトルネックとなります。

3. 解決アプローチ:ネットワークセキュリティポリシー管理(NSPM)による自動化とデータ化

これらの体系的なリスクを解決するには、個別の問題への対症療法ではなく、ネットワーク全体のセキュリティポリシーをリアルタイムに収集・分析し、管理プロセスを自動化する「ネットワークセキュリティポリシー管理(NSPM)」プラットフォームへの戦略的投資が求められます。

その具体的なソリューションとして、全世界1,700社以上の導入実績を持つ在るツールは、マルチベンダー環境のネットワーク機器から構成情報を自動収集し、一元的なデータ基盤を構築。この基盤上で、前述の4つのリスク領域に対応する具体的な機能を提供します。

ポリシーの健全性を常時スコアリングし、技術的負債を可視化・削減

変更プロセスを自動化し、レビューと監査の工数を大幅に削減

各種コンプライアンス基準に基づき、準拠状況をリアルタイムで自動アセスメント

設定情報を標準化・可視化し、運用ノウハウの属人化を解消

4. 投資対効果(ROI)を最大化するための意思決定

複雑なネットワーク環境の運用を担当する情報システム、インフラ、セキュリティ部門の責任者を対象とします。

ネットワークポリシーの現状をデータで評価し、「運用工数の削減効果」「インシデント発生確率の低減による期待損失額の抑制」「監査対応コストの圧縮」といった観点から、NSPM導入の投資対効果(ROI)を算出するための分析フレームワークを解説します。FireMonが、貴社のネットワーク運用における課題に対し、いかにして定量的な改善をもたらすかを、国内販売代理店であるKIS Securityが具体的な事例を交えて提示します。

データ主導で解き明かす欧州CRA対応の最適解:リスクの定量化と戦略的アプローチ

1. CRAがもたらす事業リスクの定量化と、データ不在による意思決定の停滞

2027年12月に完全発効する欧州サイバーレジリエンス法(CRA)は、欧州市場でビジネスを展開する製造業およびソフトウェア企業にとって、避けては通れない経営課題です。本規制への不適合は、最大で全世界売上の2.5%または1,500万ユーロのいずれか高い方の罰金、あるいは市場からの製品回収という直接的な経済損失に繋がりかねません。

多くの企業が「整合規格が未確定」であることを理由に対応を躊躇していますが、これはデータに基づかない判断の典型例であり、致命的な機会損失リスクを内包しています。本質的な課題は、自社製品に内在するサイバーセキュリティリスクを定量的かつ客観的に評価し、経営判断に繋げるデータドリブンな仕組みが欠如している点にあります。

2. データ分析の視点から紐解く、CRA対応の3つの障壁

現場で観測される混乱は、データ分析の観点から以下の3つの課題に集約できます。

リスク評価モデルの不在: 「何をどこまで対応すべきか」という問いは、製品特性、ターゲット市場、想定される脅威データを基にしたリスクアセスメントモデルがなければ答えられません。「どんな脆弱性を報告すべきか」という問いも同様に、脆弱性の深刻度(CVSSスコア等)や事業インパクトといったデータに基づき、客観的な報告基準(閾値)を設定する必要があります。

データ基盤としてのSBOM未整備: SBOM(Software Bill of Materials)の整備は、単なる部品表の作成ではありません。サプライチェーン全体にわたる脆弱性情報を一元管理し、インシデント発生時に影響範囲を即座に特定・分析するためのデータ基盤構築と捉えるべきです。この基盤なくして、CRAが要求する迅速な脆弱性管理は実現不可能です。

経営層へのレポーティング不全: 「経営層の関与不足」の根本原因は、技術的なリスクを事業インパクト(機会損失額、想定罰金額、ブランド毀損の確率など)に換算した、意思決定に資するデータが提示できていないことにあります。「セキュリティは難しい」という主観的な先入観は、客観的なデータによってのみ覆すことができます。

3. データに基づいたCRA対応戦略:現状の可視化から始める

CRA対応の第一歩は、主観や経験則を排し、自社の現在位置をデータで正確に把握することから始まります。

現状の可視化とベンチマーキング:

まず、自社の製品ポートフォリオ、開発プロセス、サプライチェーンにおけるCRA対応状況を客観的な指標で評価し、リスクをデータとして可視化します。これにより、対応すべき優先順位が明確になります。

データに基づくロードマップ策定:

アセスメント結果(データ)に基づき、リスクの高い領域から着手する、費用対効果を最大化する対応ロードマップを策定します。これは勘や経験に頼るのではなく、データに基づいた論理的な戦略です。

4. 貴社のCRA対応を加速させるデータドリブン・ソリューション

CRA対応は、コンプライアンス遵守という守りの活動であると同時に、製品のセキュリティ品質という競争優位性をデータで証明し、事業成長に繋げる攻めの機会でもあります。整合規格の公表を待つという選択は、最もリスクの高い戦略です。

本セミナーでは、大手メーカーでPSIRTを率いたリーダーの経験知と、データ分析のアプローチを融合させ、CRA対応の現実的な勘所を解説します。

解説内容の例:

「脆弱性報告体制やセキュア開発を機能させるまでに必要な工数・期間のモデル化」

「効果的なリスクアセスメント手法と、その結果を経営層に報告するためのデータ可視化テクニック」

提供ソリューション:

CRA対応状況アセスメントツール: 自社の現状を定量的に把握し、対応すべき課題を特定するためのデータ収集・分析ツールです。

CRA対応支援アドバイザリーサービス: 収集・分析したデータを基に、貴社固有のリスクプロファイルに最適化された戦略的ロードマップの策定と実行を支援します。

欧州市場でのビジネス継続性を確保するため、今すぐ自社の状況をデータで把握し、具体的な行動を開始することが不可欠です。本セミナーで、その第一歩となる知見を獲得してください。

対象となる方

欧州市場向けIoT製品・ソフトウェアの事業責任者、製品開発、品質保証、法務・コンプライアンス担当役員および管理者

全社的なITガバナンス、サイバーセキュリティ(CSIRT/PSIRT)を統括する部門の責任者・担当者

データドリブン・サプライチェーンリスク管理への変革:リスクの定量化と評価プロセスの最適化

1. リスク管理のパラダイムシフト:定性評価から定量的データ分析へ

サプライチェーンを起点とするサイバー攻撃は、もはやインシデント発生の確率論で語るべき経営リスクです。問題の本質は、自社の対策だけではコントロール不可能な外部要因、すなわち「委託先のリスクをデータとして捉え、定量的に評価・管理する仕組みの欠如」にあります。

従来のチェックリストに基づいた定性的・属人的な評価手法は、評価件数の増加に比例して工数とコストを増大させるだけでなく、リスクの見落としを誘発します。今こそ、この非効率な線形モデルから脱却し、データ分析を駆使した、予測的かつ継続的なリスク管理体制への移行が不可欠です。

2. データ分析の視点で解き明かす、既存評価プロセスの構造的欠陥

多くの企業が抱える課題は、データマネジメントの観点から以下の3点に集約されます。

評価モデルの陳腐化とリスク測定精度の低下:

静的な評価項目は、日々進化する脅威トレンドを反映できず、リスクを正しく測定する「説明変数」としての価値を失います。その結果、算出される評価は実態と乖離し、プロセス自体が形骸化します。重要なのは、脅威インテリジェンス等の外部データと連動し、リスク要因の重み付けを動的に更新する予測モデルへと進化させることです。

属人化による分析品質のばらつきと再現性の欠如:

評価プロセスが標準化・データ化されていない場合、分析品質は担当者のスキルセットに完全に依存します。これは、組織として一貫した基準でリスク許容度を測定・管理できていないことを意味し、ガバナンス上の重大な欠陥と言えます。

非効率なデータ収集プロセスとリソースの浪費:

評価対象の増加に対し、手作業でのデータ収集・集計で対応しようとすれば、工数は無限に膨れ上がります。限られた人的リソースは、データ収集という低付加価値業務ではなく、分析結果に基づくリスクシナリオの策定や、高リスク委託先への集中監査といった高付加価値業務にこそ投入すべきです。

3. データに基づいたサプライチェーンリスク管理への3ステップ

実効性のあるリスク管理体制は、以下の3つのステップで構築します。

Step 1: リスクの定量化(スコアリングモデルの導入)

各評価項目に脅威の発生可能性(Probability)と事業への影響度(Impact)に基づいた重み付けを行い、委託先ごとのリスクスコアを算出します。これにより、客観的なデータに基づいたリスクの可視化と、対応すべき優先順位の明確化が可能になります。

Step 2: データ収集・分析プロセスの自動化

スコアリングモデルを組み込んだプラットフォームを活用し、データ収集から分析、レポーティングまでを自動化します。これにより、属人性を排除し、リアルタイムでのリスク把握を実現します。

Step 3: 継続的モニタリングと評価モデルの機械学習

リスクスコアを時系列で継続的にモニタリングし、変化の兆候を早期に検知します。さらに、業界のインシデントデータ等をフィードバックし、評価モデル自体の予測精度を継続的に改善していくPDCAサイクルを構築します。

4. 実践的ソリューションによる次世代型リスク管理の実現

本セミナーでは、このデータドリブンな委託先リスク管理体制への変革を、具体的な手法と事例を交えて解説します。

解説内容:

最新の脅威トレンドを反映した、実効性の高いリスク評価モデルの設計手法。

限られたリソースで最大限の効果を発揮する、自動化を前提とした評価プロセスの構築法。

重複評価を回避し、業界全体で評価データを効率的に活用するアプローチ。

多くの企業で導入が進むプラットフォームツールを、単なるツールとしてではなく、**「サプライチェーンリスクに関するデータを集約・分析・可視化し、データドリブンな意思決定を支援するインテリジェンス・プラットフォーム」**として、その活用法を具体的にお伝えします。

形骸化した評価プロセスから脱却し、予測的かつ再現性の高いリスク管理体制を構築するための、具体的な第一歩となる知見を提供します。

中小企業のためのデータドリブン・セキュリティ投資戦略:Microsoft 365 Business PremiumのROIを最大化する方法

1. セキュリティ対策の遅延:本質はリソース不足でなく「投資対効果(ROI)の不明確さ」中小企業を標的とするサイバー攻撃の脅威レベルは、大企業と同等にまで上昇しています。にもかかわらず対策が遅延する根本原因は、人手や時間の不足ではなく、「セキュリティ投資対効果(ROI)が不明確である」という経営判断上の課題にあります。

「何を選べばよいか分からない」「分かっているのに動けない」という状況は、各ソリューションが自社の事業リスクをどれだけ低減し、運用コストをどれだけ削減できるかを、客観的なデータで評価・比較できていないことに起因します。本稿では、データに基づきセキュリティ投資を最適化するアプローチを提示します。

2. データ分析の観点から見た、中小企業のセキュリティ課題

現状の課題は、データ分析の観点から以下の3点に分解できます。

評価モデルの欠如による意思決定の停滞:

各セキュリティ製品のリスク低減効果、導入・運用にかかる総所有コスト(TCO)、工数削減効果を定量的に比較する評価モデルが存在しないため、論理的な製品選定が困難になっています。

データの散在と属人化がもたらすインシデント対応コストの増大:

PCやスマートフォンの管理台帳、ソフトウェアライセンス、セキュリティログなどのデータが散在・分断している状態では、インシデント発生時に影響範囲の特定が遅れ、事業停止時間と復旧コストが増大します。

経営層への説明責任(アカウンタビリティ)の欠如:

「なぜその投資が必要なのか」を問われた際に、想定される被害額の期待値や、対策によって削減できるコストといった定量的な根拠を提示できないため、経営承認を得られず、結果として対策が実行に移されません。

3. データで証明する最適解:Microsoft 365 Business PremiumのROI分析

Microsoft 365の下位プランからBusiness Premiumへのアップグレードは、情緒的な「簡単・最強」ではなく、データに基づいた最も合理的な投資判断として評価できます。ROIは以下の要素で構成されます。

投資(Investment):

明確なライセンスアップグレード費用。

リターン(Return):

リスク低減価値(定量的評価): Defender for Businessによるエンドポイント保護は、ランサムウェア等の想定被害額(データ復旧費、事業停止損失等)に発生確率を掛け合わせた「リスク期待値」を直接的に低減します。

運用工数削減価値(金額換算): Intuneによるデバイス管理の一元化・自動化は、手作業でのキッティングや棚卸し、パッチ管理にかかる年間工数を算出し、人件費に換算することで削減価値を明確化できます。

TCO(総所有コスト)削減: 複数の単機能セキュリティ製品を導入・運用する場合のライセンス費、保守費、学習コストの合計と、Business Premiumの費用を比較すれば、その経済的優位性は明らかです。

Business Premiumは、これらセキュリティ関連データをMicrosoft 365プラットフォーム上で統合的に収集・分析する基盤を提供し、継続的なセキュリティ状態のモニタリングと改善を可能にします。

4. 投資対効果の最大化と、データドリブンな運用体制の構築

Business Premiumの導入は、単なる製品アップグレードではなく、**「データに基づきセキュリティ投資を最適化し、事業継続性を高めるための戦略的判断」**です。

本セミナーでは、このROI分析の具体的な手法、他社の導入事例におけるコスト削減効果の生データ、そして経営層への説明にそのまま使える定量的な資料テンプレートを交えながら、現実的な導入・運用プランを解説します。

対象となる方

Microsoft 365の現行プランの費用対効果を再評価したい情シス担当者、経営層

データに基づいた客観的な根拠をもって、セキュリティ強化の必要性を説明したい方

セキュリティ対策におけるTCOを算出し、コストの最適化を図りたい方

さらに、導入支援サービスを「ROI算出からデータ活用の定着化までを伴走し、投資効果を最大化するパートナー」としてご活用いただくことで、「何を選ぶか」という議論から、「いかに投資効果を高めるか」という次のステージへと進むことができます。

セキュリティを犠牲にしない迅速なアプリケーション開発、すなわちDevSecOpsの実現には、直感や経験則だけに頼るのではなく、データに基づいた客観的な意思決定が不可欠です。Red Hatとパートナー企業が提供するエコシステムは、単にツールを導入するだけではありません。開発、セキュリティ、運用の各プロセスから生成される膨大なログやメトリクスを収集・統合し、分析するためのデータ基盤を構築します。

これにより、以下のようなKPI(重要業績評価指標)の計測と改善サイクルを回すことが可能になります。

デプロイ頻度 (Deployment Frequency): ビジネス価値をどれだけ迅速に市場に届けられているか。

変更リードタイム (Lead Time for Changes): アイデアが実装され、本番環境に展開されるまでの時間。

変更失敗率 (Change Failure Rate): デプロイに起因する障害の発生率。

平均修復時間 (Mean Time to Restore): 障害発生からサービス復旧までにかかる平均時間。

脆弱性検知から修正までの時間 (Time to Remediate Vulnerabilities): セキュリティリスクへの対応速度。

これらのメトリクスを継続的に監視・分析することで、プロセスのボトルネックを特定し、データに基づいてリソースを最適配分できます。結果として、開発速度の向上、リスクの定量的低減、そしてデータに基づいたコラボレーション文化の醸成を同時に実現します。

2. 組織施策の効果測定:感覚的な「工夫」からデータに基づく「改善」へ

多くの企業で実施されている「社内研修」や「内部通報制度」は、その効果が定性的に語られがちです。しかし、これらの施策もデータ分析の対象とすることで、投資対効果を最大化できます。

社内研修:学習効果の最大化に向けたデータ分析

研修の目的は「分かりやすさ」の追求ではなく、「受講者の行動変容」と「リスクの低減」です。その効果を測定するために、以下のデータを活用します。

研修前後での理解度テスト: 正答率の変化を測定し、研修コンテンツの有効性を定量的に評価します。特に正答率の低い設問を特定し、コンテンツ改修の具体的なインプットとします。

受講完了率と所要時間: 研修時間(例:15分 vs 30分)や形式(動画、クイズ形式など)による完了率やエンゲージメントの違いをA/Bテストで検証し、最適なフォーマットを導き出します。

アンケートデータの構造化: 満足度を5段階評価で取得するだけでなく、NPS(Net Promoter Score)を導入して推奨度を測ります。自由記述欄はテキストマイニングで分析し、改善に繋がるインサイトを抽出します。

行動変容の追跡: 研修で扱ったテーマに関連するインシデント(例:パスワードの不適切な管理)の発生率が、研修後にどう変化したかを長期的に追跡・分析します。

これらの分析結果に基づき、PDCAサイクルを回すことで、研修は「実施すること」が目的のコストセンターから、「組織のリスクを低減する」プロフィットセンターへと変貌します。

内部通報・相談窓口:潜在リスクの早期発見とプロセスの最適化

内部通報・相談窓口は、受動的な対応に留まらず、組織の健全性を示す重要なデータソースと捉えるべきです。

データに基づく潜在リスクの検知: 通報・相談内容をカテゴリ分類し、その件数や傾向を経時的に分析します。特定の部署や時期に特定の相談が増加していないかといった異常検知モデルを構築し、重大インシデントへの発展を未然に防ぐプロアクティブな介入を可能にします。

プロセスの客観性と公平性の担保: 調査プロセスにおける各フェーズ(ヒアリング、事実認定、処分決定など)の所要時間を計測し、ボトルネックや遅延を特定します。また、過去の類似案件データを参照し、判断基準のばらつきをなくすことで、客観的で公平なプロセスを担保します。

アクセスログの監視と監査: 通報・相談内容を格納するフォルダやシステムへのアクセスログを常時監視し、権限外の不審なアクセスを自動検知するアラートを設定します。これにより、通報者の秘密保持という最重要事項をテクノロジーで担保します。

KPIによる運用状況のモニタリング: 「平均解決日数」「匿名通報の割合」「通報後の報復事案発生率(アンケート等で計測)」などをKPIとして設定し、窓口機能が健全に運用されているかを継続的に評価します。

3. AI/機械学習による運用の高度化:人手作業からデータ主導の自動化へ

複雑化するIT環境において、セキュリティと安定性を維持するためには、人手による監視と分析には限界があります。SplunkのAIソリューションは、膨大なマシンデータをリアルタイムで分析し、運用を高度化するための強力なエンジンとなります。

Splunk IT Service Intelligence (ITSI):IT運用データとビジネスKPIの相関分析

ITSIは、サーバーやネットワーク機器から出力されるログ、メトリクスといったIT運用データを収集・分析するだけでなく、それらがビジネスに与える影響を可視化する分析ソリューションです。

ビジネスインパクトの可視化: 個別の技術的なアラート(例:CPU使用率90%超)ではなく、それがどのビジネスサービス(例:ECサイトの決済機能)のパフォーマンス低下に繋がり、結果としてどれだけの機会損失を生む可能性があるかを予測します。これにより、対応の優先順位をデータに基づいて決定できます。

根本原因の迅速な特定: 複数のシステムにまたがって発生するイベントやログをAIが自動的に相関分析し、インシデントの根本原因を特定するまでの時間(MTTR: Mean Time to Resolution)を劇的に短縮します。

予兆検知とプロアクティブな問題解決

KPI Drift Detection (KPIの変動検知): 静的な閾値(例:レイテンシーが1秒を超えたらアラート)では検知できない、緩やかで長期的なパフォーマンスの劣化(数ヶ月かけてレイテンシーが徐々に上昇)を機械学習が自動的に検出します。これにより、大規模なサービス障害が発生する前に、プロアクティブに対処することが可能になります。

動的しきい値: ビジネスの繁閑やシステムの季節変動に応じて、AIが正常状態のベースラインを継続的に学習し、アラートの閾値を自動で調整します。これにより、誤検知による「アラート疲れ」をなくし、本当に重要なインシデントを見逃さない、高精度な監視体制を構築します。

これらのAI機能を活用することで、IT運用チームは、日々発生する無数のアラート対応という受け身の作業から解放され、データ分析に基づく将来の障害予測や、サービスの継続的改善といった、より付加価値の高い業務に集中できるようになります。

1. 課題の定量化:セキュリティ運用におけるデータ活用の必要性

増大し続けるログデータの中から、人手によるトリアージのみでインシデントの根本原因やビジネスインパクトを迅速に特定するオペレーションは、もはや限界に達しています。このアプローチは、**平均対応時間(MTTR: Mean Time To Respond)**の遅延と分析精度の低下に直結し、事業リスクを増大させます。

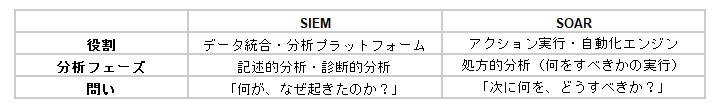

データドリブンなセキュリティ運用への転換は、この課題を克服するための唯一の解です。その中核となるのが、多様なデータソースを統合し、相関分析を通じてインシデントの予兆や攻撃の傾向を可視化するSIEM (Security Information and Event Management)です。SIEMは、何が起きたか(What)、なぜ起きたか(Why)を明らかにする「記述的分析」「診断的分析」の基盤となります。

2. データに基づく投資判断フレームワーク

セキュリティソリューションへの投資は、感覚や流行ではなく、客観的なデータに基づいて判断されるべきです。NIST(米国国立標準技術研究所)のサイバーセキュリティフレームワークは、投資領域を特定し、その効果を測定するための優れたKPI管理の枠組みを提供します。

特定 (Identify) & 保護 (Protect):

役割: 資産の脆弱性や構成不備、既知の脅威パターンをどれだけ正確に把握し、防御できているか。

主なソリューション: SIEM

計測すべきKPI例: 脆弱性スキャンによる重要インシデントの発見率、ポリシー違反の検知数、防御ルールの適用カバレッジ。SIEMはこれらの活動の有効性を測定し、改善の方向性を示します。

検知 (Detect) & 対応 (Respond):

役割: 侵入やインシデントをいかに迅速に検知し、封じ込め、根絶するか。

主なソリューション: SOAR (Security Orchestration, Automation and Response)

計測すべきKPI例: 平均検知時間(MTTD: Mean Time To Detect)、平均対応時間(MTTR)。SOARはこれらの時間を短縮するための自動化エンジンです。

3. SIEM強化 vs SOAR導入:判断を左右するデータシグナル

自社のセキュリティ成熟度に応じて、SIEMの強化とSOARの導入のどちらを優先すべきか。その判断は、SOC(Security Operation Center)の活動データから導き出されます。

SIEMの強化に投資すべきデータシグナル:

高い誤検知率 (False Positive Rate): アラート総数に占める誤検知の割合が高く、アナリストがノイズの分析に時間を浪費している。

MTTDの悪化: 重大インシデントの検知までに時間がかかっている、または検知できていない。

低いデータカバレッジ: 分析対象となるログやデータソースが限定的で、インシデントの全体像を把握できない。

インシデント管理プロセスの非標準化: 対応手順が担当者ごとに異なり、分析結果の再現性や品質にばらつきがある。

これらの指標が悪化している場合、まずはSIEM基盤とそのデータ収集・分析プロセスを強化し、入力されるデータの質と分析の精度を高めることが賢明な投資です。

SOARの導入を検討すべきデータシグナル:

MTTRの目標未達: インシデントの検知はできている(MTTDは短い)が、その後の対応(調査、封じ込め、復旧)に時間がかかりすぎている。

アナリストの業務負荷: アナリストの総業務時間のうち、定型的なアラートの一次調査やチケット起票、関係者への連絡といった手作業に費やす割合が閾値(例: 50%)を超えている。

標準化された対応手順の存在: 多くのインシデントに対して、標準化された対応手順(プレイブック)が確立されているが、その実行が手動である。

アナリストが高度な分析や未知の脅威のハンティングではなく、繰り返しの定型作業に忙殺されている状態は、SOARによる自動化で大幅な生産性向上が見込める明確なサインです。

4. ソリューション価値の最大化:データモデルとしてのプレイブック

SOARの導入効果は、単にツールを導入するだけでは得られません。その価値は、組織固有のインシデント対応プロセスを**「プレイブック」**としてコード化し、データに基づいて継続的に改善していくことで最大化されます。

ファイアウォールやプロキシの再構成、ホストの隔離といったアクションをSOARに実行させることは、単なる構成変更ではありません。それは、**「分析結果に基づき、定義されたリスクシナリオに応じて、最適な対応アクションをミリ秒単位で自動実行する」**というデータドリブンな意思決定プロセスの実装です。

SOARの運用期間が長くなるほど、処理したインシデントデータが蓄積されます。このデータを分析することで、プレイブックの精度は向上し、アナリストの介在なしで対応可能なインシデントの割合(自動化率)は着実に高まっていきます。

結論:データに基づいた最適なソリューション・ポートフォリオの構築

最終的なセキュリティ投資の成功は、自社の現状をデータで正確に把握することから始まります。

現状のKPIを計測・可視化する: まず自社のMTTD、MTTR、誤検知率、アナリストの工数配分などのベースラインを測定します。

脅威とリスクをモデル化する: 自社のビジネス環境における脅威シナリオと、それがもたらす事業リスクを定量的に評価します。

アーキテクチャを設計する: 上記のデータに基づき、自動化で解決すべき課題と、高度な人間の分析が必要な課題を切り分けます。その上で、単一ベンダーのスイート製品か、各領域で最適なツールを組み合わせるベストオブブリードのアプローチかを選択することで、機能不足や過剰投資を回避し、投資対効果(ROI)を最大化するソリューションポートフォリオを構築することが可能になります。

1. セキュリティ運用の課題:爆発するデータをいかに価値に変えるか

現代のITインフラから生成されるログデータは、その量(Volume)、速度(Velocity)、多様性(Variety)において爆発的に増大し続けています。これらのデータは、セキュリティインシデントの予兆や痕跡を示す極めて重要な情報資産ですが、同時に、人手による分析能力の限界をはるかに超えています。

このデータ課題に対し、どのテクノロジーを、どの順番で導入し、どのように運用するかという戦略が、セキュリティ運用の成否を分けます。その中核となるアーキテクチャが、SIEMとSOARです。両者の違いをデータ処理のパイプラインという観点から再定義し、自社のデータ成熟度に応じた最適な選択を論じます。

2. SIEM:セキュリティデータの統合・分析プラットフォームとしての役割と限界

SIEM(Security Information and Event Management)は、サイロ化された各セキュリティ機器(ファイアウォール、IDS、エンドポイントなど)のログを一元的に集約し、横断的な相関分析を可能にするためのデータ統合・分析基盤と定義できます。

その主要な機能は、データ分析のプロセスに沿って以下のように整理されます。

データ収集と正規化: 多様なフォーマットのログデータを収集し、統一された形式(正規化)に変換することで、分析可能な状態にします。これは分析パイプラインにおけるETL(Extract, Transform, Load)プロセスに相当します。

記述的・診断的分析: 「何が起きたか」をダッシュボードで可視化し(記述的分析)、アナリストがドリルダウン検索を通じて「なぜ起きたか」を調査する(診断的分析)ための対話的なインターフェースを提供します。

検知ロジックの実装: 既知の攻撃パターンや異常な振る舞いをイベントシーケンスとしてルール化し、条件に合致した場合にアラートを生成します。

しかし、SIEMにはデータ処理能力と、分析後のアクションにおける構造的な限界が存在します。1秒あたり数千イベント(EPS)にも達するデータストリームに対し、すべてをリアルタイムで高度に分析し、次のアクションに繋げることは容易ではありません。SIEMが生成するアラートはあくまで「分析結果」であり、それ自体がインシデントを解決するわけではないのです。

3. 「1/10/60チャレンジ」:データが示す、人間による分析の限界

近年のAPT(持続的標的型脅威)グループは、標的のネットワークに侵入後、平均2時間以内、最速では20分未満で内部活動を開始するというデータがあります。この速度に対抗するための目標として「1/10/60チャレンジ」というSLA(Service Level Agreement)が提唱されています。

1分以内に検知 (Detect)

10分以内に状況を理解・分析 (Understand)

60分以内に封じ込め (Contain)

このSLAを遵守するには、データ処理の観点から人間による手動オペレーションには限界があることが明らかです。最高レベルのスキルを持つアナリストでも、SIEMが生成する膨大なアラートを一つ一つ調査し、10分で状況を判断し、60分で対応を完了させることは極めて困難です。特に「理解」と「封じ込め」のフェーズにおいて、人間系のプロセスが致命的なボトルネックとなります。

4. SOAR:分析結果をアクションに転換する自動化エンジン

このボトルネックを解消するのが、SOAR(Security Orchestration, Automation and Response)です。SOARは、SIEMなどから出力されたアラート(分析結果)をトリガーとして、あらかじめ定義されたワークフロー(プレイブック)を自動実行するオーケストレーション・エンジンです。

SIEMとSOARの関係は、データパイプラインにおける役割分担として明確に定義できます。

SIEMがインテリジェンスを生成し、SOARがそのインテリジェンスに基づいてアクションを実行する。この連携により、「1/10/60」という厳しいSLAの達成が初めて現実的な目標となります。

結論:データ成熟度に応じたアーキテクチャの選択

「SIEMかSOARか」という二者択一の問いは、本質的ではありません。問うべきは、「自社のセキュリティ運用とデータ分析の成熟度はどの段階にあり、次の一手としてどちらに投資すべきか」です。

フェーズ1:データの収集と可視化

ログがサイロ化され、インシデントの全体像を把握できていない段階。まずはSIEMを導入し、セキュリティデータを一元的に収集・可視化する基盤を構築することが最優先です。

フェーズ2:分析と対応の効率化・自動化

SIEMから多数のアラートが上がるものの、アナリストの対応が追いつかずMTTRが悪化している段階。標準化された対応手順を持つインシデントからSOARの導入を開始し、定型作業を自動化してアナリストを高度な分析業務に集中させます。

最終的に目指すべきは、SIEMを強力な分析基盤とし、SOARを迅速なアクション基盤とする、統合的かつ自動化されたデータドリブンなセキュリティアーキテクチャの構築です。