目次

- 1 生成AI活用の次なるフロンティア:リアルタイム異常検知と高精度RAGが拓く事業価値

- 2 CopilotにおけるRAGアーキテクチャの戦略的価値:データ活用による競争優位性の確立

- 3 Microsoft 365 Copilotの進化と拡張性:エンタープライズ生成AIのビジネス実装フェーズへ

- 4 生成AI導入の現実解:データに基づくPoCとROI試算による戦略的アプローチ

- 5 生成AIによる開発革命の光と影:コード生成のリスクマネジメントと品質保証の新パラダイム

- 6 AI投資のROIを最大化するストレージ戦略:HDD/SSDの最適配置によるデータインフラの最適化

- 7 考察:TCO(総所有コスト)の視点に基づく意思決定

- 8 2025年 CIOが下すべきクラウド戦略:生成AIによる価値創出を最大化する次なる一手

- 9 生成AIの価値を最大化する「RAG」と「ベクトル検索」:データサイロを克服し、信頼できるAIを実現する実践的アプローチ

- 10 AI時代のデータアーキテクチャ戦略:「データグラビティ」を制し、ハイブリッドAIの価値を最大化する

生成AI活用の次なるフロンティア:リアルタイム異常検知と高精度RAGが拓く事業価値

【エグゼクティブサマリー】

生成AIの活用は、定型的なナレッジ検索や文章生成のフェーズを超え、事業の根幹に関わるクリティカルな業務へと拡大している。本稿では、特に「監視・点検業務における未知の異常検知」と「高精度な社内情報検索」という2つのユースケースに着目。これらの実用化を阻む、従来のAIにおけるデータ不足の課題や、RAG(Retrieval-Augmented Generation)におけるデータ鮮度の問題を構造的に分析する。その上で、学習データに依存しない異常検知、RAGの精度を9割以上に高める最適化手法、そしてAIの信頼性を担保するリアルタイムデータ連携アーキテクチャについて、具体的なソリューションと導入アプローチを交えて解説する。

1. 【ユースケース分析①:監視・点検】”未知の異常”をどう捉えるか – 従来のAIの限界と生成AIによるブレークスルー

課題分析:

設備、工場、インフラなど多様な現場において、監視・点検業務は深刻なリソース不足と、人的ミスによる重大インシデントのリスクを内包している。従来のAIによる自動化アプローチは、以下の技術的限界に直面してきた。

異常データの希少性: 教師あり学習モデルを構築しようにも、「設備故障」や「侵入」といった異常事象のデータは絶対数が不足しており、モデルの汎化性能を確保できない。

未知の異常への非対応: 異常のパターンは無限に存在するため、事前に定義された異常しか検知できないAIでは、予期せぬインシデント(例:「いつもと違う煙の出方」「微量な液体漏れ」)を見逃す。

実用性に乏しい精度: 教師なし学習による異常検知も、誤検知や見逃しが多く、現場オペレーションに組み込むには信頼性が不足していた。

セキュリティ制約: 機密性の高い現場映像やデータをクラウドAIサービスに送信することは、セキュリティポリシー上許容されず、導入の障壁となっていた。

解決アプローチ:

これらの課題に対し、「生成AI×動画解析」は新たな解を提示する。このアプローチは、少量の「正常データ」のみを学習し、正常状態のパターンを深く理解する。そして、その正常モデルから逸脱した**「未知の逸脱事象」**をリアルタイムに検知する。これにより、異常データの収集が不要となり、オンプレミス環境でのセキュアな運用も可能になる。これは、受動的な録画確認から、予兆を捉えるプロアクティブな安全監視へのパラダイムシフトを意味する。

2. 【ユースケース分析②:ナレッジ活用】PoCの壁を越える、現実的な生成AI導入戦略

課題分析:

情報システム部門や事業部門は、「社内に散在するFAQ、仕様書、営業資料といった非構造化データを活用し、業務効率化や顧客対応品質を向上させたい」という強いニーズを持つ。しかし、多くのプロジェクトが以下の理由で停滞している。

ROIの不透明性: 投資対効果を定量的に示せないまま、本格的な開発に着手できない。

技術リソースの不足: RAGの精度向上やシステム構築を担える専門人材が社内に不在。

導入アプローチの欠如: 何から始め、どう効果を測定し、どうスケールさせるかのロードマップが描けない。

解決アプローチ:価値検証(PoV)からの段階的展開

大規模開発ではなく、ビジネス価値を実証するPoV(Proof of Value)から始めることが成功の鍵となる。

迅速なプロトタイピング: ノーコード開発環境**「Dify」**などを活用し、特定のユースケースに絞った生成AIアプリケーションを迅速に構築。技術的な実現可能性と業務上の有効性を短期間で検証する。

RAG精度の極大化: PoCで直面する「AIが正しく答えない」という課題に対し、東大松尾研発のAlmondo社が持つ検索精度9割以上を実現したRAG最適化技術は、実用化への強力な武器となる。

実務展開への移行: Microsoftテクノロジーに精通したテンダ社のようなパートナーと連携し、PoVで得た知見を基に、Microsoft Copilotとの連携や、構造化データも活用した本格的な業務システムへの展開を推進する。

3. 【横断的技術課題】AIの信頼性を左右する「データ鮮度」の問題

RAGアーキテクチャの性能は、参照するナレッジベースの品質だけでなく、「鮮度」にも大きく依存する。

課題分析:ハルシネーションを誘発するデータのタイムラグ

バッチ処理などで更新されるデータソースに依存したRAGは、致命的な問題を抱える。

状況認識の誤り: 数時間前、数日前の情報に基づき回答を生成するため、最新の状況を反映できず、誤った意思決定を導くリスクがある。

ハルシネーション(情報の捏造): 参照データ内に回答の根拠が存在しない場合、AIがもっともらしい嘘を生成する現象は、データの鮮度が低い場合に特に発生しやすい。

解決アプローチ:イベントストリーミングによるリアルタイムデータ連携

この課題を解決するには、データが発生した瞬間にそれを捉え、リアルタイムでAIに連携するアーキテクチャが不可欠となる。

リアルタイムデータ基盤の構築: Confluentに代表されるイベントストリーミングプラットフォームは、継続的に発生するデータ(イベント)をリアルタイムで捕捉・処理し、AIのナレッジベースを常に最新の状態に保つことを可能にする。

アーキテクチャ設計の要点: データフローをどう設計し、データ更新のタイムラグをいかに最小化するかが重要となる。本セッションでは、リアルタイムRAGを実現するための最適なアーキテクチャと、その実装における技術的ポイントを、実際のユースケースを交えて解説する。

本セッションの対象者:

生成AIの具体的な業務適用と、その投資対効果の算出に課題を持つ企業の意思決定者・管理職。

社内データ(非構造化・構造化)を安全かつ高精度に活用する手法を模索する情報システム部門、DX推進部門の担当者。

AIによる監視・検知業務の自動化・高度化を検討している現場の責任者。

CopilotにおけるRAGアーキテクチャの戦略的価値:データ活用による競争優位性の確立

Microsoft 365 Copilotは、単なる業務効率化ツールではありません。これは、企業の知的資産を最大限に活用し、データドリブンな意思決定を組織全体に浸透させるための、強力なデータ活用プラットフォームです。その中核をなす技術がRAG (Retrieval-Augmented Generation: 検索拡張生成) です。本稿では、RAGの技術的本質と、そのポテンシャルを最大化するためのデータ戦略について解説します。

RAGの本質:LLMの課題を克服し、企業コンテキストを注入するアーキテクチャ

Copilotの推論エンジンには、Azure OpenAI Service上で稼働する大規模言語モデル(LLM)が採用されています。しかし、LLMは一般的な知識には長けているものの、企業固有の文脈や最新の社内情報を理解しているわけではありません。このギャップを埋め、LLMがもっともらしい嘘(ハルシネーション)を生成するリスクを抑制するのがRAGの役割です。

RAGは、以下の2つの主要な技術要素によって、LLMに企業固有のコンテキストを動的に提供します。

セマンティックインデックス & ベクトル検索: Microsoft 365内の非構造化データ(ドキュメント、メール、Teamsチャットなど)を、単なるキーワードではなく、意味的な関連性で検索可能にします。各データは意味内容を表すベクトル(数値の配列)に変換され、インデックス化されます。ユーザーからのプロンプト(指示)も同様にベクトル化され、ベクトル空間上で意味的に「近い」情報を高速に検索・特定します。これにより、社内に散在しがちな**「ダークデータ」を価値ある情報資産へと転換**させることが可能になります。

動的なコンテキスト注入: ユーザーのプロンプトに応じて、上記の方法で検索・取得された関連情報(コンテキスト)を、LLMへの入力に付加します。LLMは、この**「根拠情報付きのプロンプト」**に基づいて回答を生成するため、組織のデータとファクトに準拠した、精度の高いアウトプットが実現します。

RAGの性能はデータ品質に依存する:データガバナンスの重要性

RAGアーキテクチャの有効性は、インプットとなるデータの品質に決定的に依存します。「Garbage In, Garbage Out(ゴミを入れればゴミしか出てこない)」 の原則は、RAGにおいても例外ではありません。出力の精度と信頼性を担保するためには、以下の観点でのデータマネジメントが不可欠です。

情報の鮮度と正確性: 古く陳腐化した情報や、誤りを含むデータは、LLMに誤ったコンテキストを与え、不正確なアウトプットを導きます。情報ライフサイクル管理の徹底が求められます。

関連性と網羅性: プロンプトに対して真に関連性の高い情報が検索対象に含まれている必要があります。データのサイロ化を防ぎ、必要な情報へ適切にアクセスできる環境の整備が重要です。

アクセス権管理: Copilotは、ユーザーに付与されたアクセス権の範囲内で情報を検索します。厳格かつ適切なアクセス権管理は、情報セキュリティを担保し、意図しない情報漏洩を防ぐための絶対条件です。

Copilotにおけるデータフローの技術的考察

ユーザーがプロンプトを送信してから回答が生成されるまで、バックエンドでは以下のプロセスが実行されます。

プロンプトの解釈とグラウンディング: プロンプトはまずCopilot Orchestratorによって解釈されます。Orchestratorは、Microsoft Graph APIをコールし、ユーザーのプロンプトの意図と意味的に関連性の高いデータチャンク(情報の断片)を、M365テナント内のベクトル化されたインデックスから検索・取得します。このプロセスを「グラウンディング(Grounding)」と呼び、LLMの回答を組織のデータに根付かせます。

コンテキスト化されたプロンプトの生成: Orchestratorは、元のプロンプトと、グラウンディングによって取得したデータチャンクを結合し、LLMへの最終的な入力(コンテキスト化されたプロンプト)を構築します。

LLMによる回答生成と提示: この拡張されたプロンプトがAzure OpenAI Serviceに送信されます。LLMは与えられたコンテキスト情報に基づき、ファクトに準拠した回答を生成。最終的なアウトプットが、WordやTeamsといったアプリケーションのUIを通じてユーザーに提示されます。

結論:Copilot導入はデータマネジメント戦略の見直しから

Microsoft 365 CopilotとRAGの導入は、単なるツール展開プロジェクトではなく、自社のデータガバナンスとデータマネジメントの成熟度を測る試金石です。その効果を最大化するには、全社的なデータ戦略の見直しが不可欠です。

高品質なデータを整備し、適切なアクセス権管理を徹底すること。これこそが、Copilotを真の「知的生産性向上プラットフォーム」へと昇華させ、持続的な競争優位性を築くための鍵となります。

Microsoft 365 Copilotの進化と拡張性:エンタープライズ生成AIのビジネス実装フェーズへ

Microsoft 365 Copilotは、単なるオフィスアプリケーションの補助機能を越え、企業のデータとビジネスプロセスに生成AIを組み込むための戦略的プラットフォームへと進化を続けています。その本質は、LLM(大規模言語モデル)を企業のコンテキストに適合させ、組織の知的生産性を最大化する点にあります。本稿では、Copilotの機能進化をデータ活用の観点から分析し、そのビジネスインパクトと、企業が取るべき戦略について考察します。

プラットフォームとしての進化:APIエコシステムとカスタマイゼーション

2023年11月のリリース以降、Copilotは単体機能の強化に留まらず、プラットフォームとしての拡張性を飛躍的に高めています。データ戦略上、特に注目すべきは以下のアップデートです。

データ連携の深化(Planner, OneDrive):

Microsoftエコシステム内でのデータ連携が強化され、非構造化データ(OneDrive上のファイル)と半構造化データ(Planner上のタスク)をシームレスに横断したコンテキストでのAI活用が可能になりました。これは、サイロ化しがちな情報を統合し、より網羅的で精度の高いインサイトを導出するための基盤が強化されたことを意味します。

拡張性とカスタマイゼーション(API & Copilot Studio):

Copilotの戦略的価値を最も高めるのが、この拡張性です。

Microsoft Copilot Studio: これは、ローコード/ノーコードで独自のCopilotを構築・カスタマイズするための設計ツールです。特定の業務プロセスやナレッジベースに特化した**「特化型AIアシスタント」**を内製化できます。これにより、全社共通の汎用的なAIではなく、経理、人事、営業といった各部門の固有の課題解決に直結するソリューションを、現場主導で迅速に開発・展開することが可能になります。

APIによる外部連携: サードパーティの基幹システム(ERP, CRMなど)やSaaSとのAPI連携は、CopilotがアクセスできるデータソースをMicrosoft 365の枠を超えて拡張します。これは、Copilotを企業のデータファブリックにおける中核的なインターフェースとして位置づけ、既存のIT資産と生成AIを融合させるための重要な布石です。

ビジネスプロセスの変革:非構造化データの構造化とインサイト抽出

Copilotの導入は、日常的な業務オペレーションをデータ活用の観点から再定義します。これは単なる「作業の自動化」ではなく、「業務プロセスから生まれるデータの資産化」を意味します。

ケース1:ドキュメント生成(Microsoft Word)

プロンプトに応じてドキュメントの下書きを作成する機能は、「ゼロから書く」時間を削減するだけではありません。過去の提案書や報告書といった社内の優良な非構造化データを参照させることで、アウトプットの品質を標準化・高度化するナレッジマネジメントの実践そのものです。属人化しがちなドキュメント作成ノウハウを、組織の共有資産へと転換させます。

ケース2:会議インテリジェンス(Microsoft Teams)

Web会議の支援機能は、Copilotの価値が最も顕著に現れる領域の一つです。

非構造化データのリアルタイム構造化: 会議中の音声というリアルタイム性の高い非構造化データを、Copilotは即座にテキスト化し、「議事録」「決定事項」「ToDo(担当者・期限付き)」といった構造化データに変換します。これは、会議後の議事録作成といった間接業務を撲滅するだけでなく、会議で生まれた価値を確実に次のアクションに繋げるための仕組みです。

会議データの資産化と分析: 「会議の主要テーマは何か」「誰がどのような意見を述べたか」といった要約・分析機能は、これまで活用が困難であった会議データを検索・分析可能な知的資産へと変えます。これにより、過去の意思決定プロセスの透明化、組織横断的なナレッジ共有、さらには部門間の会話から新たなビジネスインサイトを発見する、といった高度なデータ活用への道が拓かれます。

結論:生成AIのビジネス実装に向けた次の一手

Microsoft 365 Copilotは、「ChatGPTのオフィス版」という初期の比喩的理解から脱却し、企業のデータとナレッジを統合し、ビジネスプロセスにインテリジェンスを注入するコア・プラットフォームとしての地位を確立しつつあります。

このプラットフォームを最大限に活用するためには、単にライセンスを導入するだけでは不十分です。今、企業に求められるのは、以下の戦略的アクションです。

プロンプトエンジニアリング能力の育成: AIから価値あるアウトプットを引き出すための対話能力を、全社的なリテラシーとして向上させる。

Copilot Studioの活用戦略: どの業務領域に特化したAIアシスタントを開発すれば投資対効果が最大化されるかを見極め、内製化計画を策定する。

データ基盤の再評価: API連携を前提とし、Copilotが参照すべき社内外のデータソースを特定し、データ品質とセキュリティを確保する。

Copilotの真価は、組織が保有する独自のデータと組み合わせ、特定のビジネス課題を解決するようカスタマイズして初めて発揮されます。その活用は、企業のデータ戦略とDXの成熟度を直接的に反映するものとなるでしょう。

生成AI導入の現実解:データに基づくPoCとROI試算による戦略的アプローチ

昨今の生成AIブームは、技術的なブレークスルー以上に、ユーザーエクスペリエンスの変革、すなわち「使う側の意識の変化」によって牽引されています。自然言語で対話できるインターフェースは、専門家以外にもAIの活用を可能にし、ビジネス実装への期待を飛躍的に高めました。

しかし、この期待を具体的な事業価値に転換するためには、熱狂から一歩引いた冷静な投資判断が不可欠です。本稿では、Microsoft 365 Copilotのような生成AIツールを組織に導入するにあたり、リスクを抑制し、投資対効果(ROI)を最大化するためのデータドリブンなアプローチを提言します。

フェーズドアプローチ:PoCによる効果の可視化と導入リスクの制御

先進技術の全社一斉導入は、不確実性が高く、失敗した場合の損失も甚大です。そこで、以下のような段階的な導入戦略(フェーズドアプローチ)が極めて有効となります。

1. PoC(Proof of Concept:概念実証)フェーズ:特定領域での効果の定量化

まず、導入効果を最も測定しやすく、かつ影響範囲を限定できる部門(例:ソフトウェア開発部門)を対象に、PoCを実施します。このフェーズの目的は、全社展開の是非を判断するための客観的なデータ取得です。

対象部門の選定理由(ソフトウェア開発の場合):

Copilotによるコード生成、リファクタリング、テストケース作成といった支援機能が、開発プロセスに直接的な影響を与える。

「コード記述時間」「コミットからデプロイまでのリードタイム」「コードレビュー工数」「バグ修正時間」など、定量的な評価指標(KPI)を設定しやすい。

実施項目:

ベースライン計測: PoC開始前に、現行のKPIを正確にデータとして計測します。これが効果測定の基準点となります。

効果測定: PoC期間中、Copilot利用グループと非利用グループのKPIを比較分析し、生産性向上効果を数値で可視化します。

このアプローチにより、リスクを最小限に抑えつつ、ツールの実用性と具体的な効果をデータに基づいて証明し、次のステップへの客観的な判断材料を確保します。

2. パイロット展開フェーズ:展開モデルの最適化

PoCで有効性が確認できた場合、次に対象部門をいくつか追加し、パイロット展開に移行します。このフェーズの目的は、全社展開に向けた運用モデルの最適化と課題の洗い出しです。定量的データに加え、ユーザーからの定性的なフィードバックを体系的に収集・分析することが重要になります。

データに基づく投資対効果(ROI)の試算と経営層への説明責任

テクノロジー投資において、経営層が最も重視するのはROIです。Copilot導入の意思決定を促進するには、期待や定性的なメリットを語るだけでなく、データに基づいた財務的利益を明確に提示する必要があります。

効果測定フレームワークの設計

ROIを算出するためには、まず効果を体系的に分類し、それぞれを可能な限り数値化するフレームワークを設計します。

投資(Investment):

ライセンス費用

導入支援・コンサルティング費用

従業員へのトレーニングコスト

リターン(Return):

直接的コスト削減効果(定量化が容易):

反復作業・定型業務の自動化による工数削減を算出します。

算出式例: (削減期待工数 [時間] × 平均時間単価 [円/時間]) × 対象人数

生産性向上による価値創出(定量化に工夫が必要):

開発サイクルの短縮による市場投入の迅速化(機会利益)や、創出された時間をより高付加価値な業務(例:新機能の企画、高度な分析)に再配分することによる価値を評価します。

定性的効果の代理指標(Proxy)による評価:

「従業員エンゲージメントの向上」や「イノベーションの促進」といった直接的な金額換算が困難な効果も、**「離職率の低下」「従業員満足度スコアの向上」「新規事業提案数の増加」**といった代理指標の目標値を設定し、その達成度で評価します。

これらのフレームワークに基づき、PoCで得られた実測データを活用して精度の高いROIを試算し、導入が単なるコストではなく、具体的なリターンを生む戦略的投資であることを論理的に証明します。このデータに基づくアプローチこそが、組織全体の合意形成を円滑にし、プロジェクトを成功に導く鍵となります。

生成AIによる開発革命の光と影:コード生成のリスクマネジメントと品質保証の新パラダイム

生成AI、特にLLM(大規模言語モデル)の進化は、ソフトウェア開発の生産性を飛躍的に向上させるポテンシャルを秘めています。これは単なるコード補完ツールの延長ではなく、開発プロセスそのものを変革するパラダイムシフトです。

しかし、この「生産性向上」という光の側面は、「品質・セキュリティ・ガバナンス」という影の側面と不可分です。本稿では、このトレードオフをデータとプロセスの観点から分析し、コード生成AIのリスクを制御しつつ、その便益を最大化するための戦略的アプローチを提言します。

リスク分析:生成コードは「技術的負債」の新たな発生源となりうる

ソースコード生成AIを無批判に受け入れることは、将来の「技術的負債」を意図せず蓄積するリスクを伴います。そのリスクは、以下の3つのカテゴリーに大別されます。

品質リスク:

AIが生成するコードは、一見して動作するように見えても、潜在的なバグ、パフォーマンス上のボトルネック、あるいは極端に保守性の低い(可読性や再利用性が欠如した)コードを含んでいる可能性があります。これは、短期的な開発速度と引き換えに、長期的な運用・保守コストを増大させる要因となります。

セキュリティリスク:

AIは、学習データに含まれる脆弱なコードパターンを再生産する可能性があります。SQLインジェクションやクロスサイトスクリプティングといった既知の脆弱性(CWE)を含むコードが意図せず生成され、そのままデプロイされることは、重大なセキュリティインシデントに直結します。

コンプライアンスおよび知的財産(IP)リスク:

AIの学習データには、多様なライセンス(GPLなど)を持つオープンソースソフトウェアのコードが含まれています。生成されたコードにこれらのコード片が意図せず混入した場合、自社製品が意図しないライセンスに制約されたり、著作権侵害を問われたりするリスクが存在します。

「90%の確率で適切なコードを生成できる」という評価は、裏を返せば10%の確率で問題を引き起こすことを意味します。ビジネスシステムにおいて、この**「テールリスク」(発生確率は低いが、一度発生すると甚大な損害をもたらすリスク)**の管理は極めて重要です。

戦略的提言:AI時代のDevSecOpsと品質保証フレームワークの再構築

リスクを管理し、生成AIを安全な形で活用するためには、従来の品質保証プロセスをAI時代に適応させる必要があります。これは、AIを単なるツールとしてではなく、**「極めて有能だが、時に間違いを犯す新人プログラマー」**とみなし、そのアウトプットを体系的にレビューする文化と仕組みを構築することに他なりません。

具体的なアクションプランは以下の通りです。

1. 生成AI利用に関するガバナンスとガイドラインの策定

まず、組織としてAIコード生成ツールの利用ルールを明確に定義します。

許容範囲の定義: どのプロジェクト、どの開発フェーズで利用を許可するか。

機密情報の取り扱い: プロンプトに機密情報や個人情報を含めることを厳禁する。

レビュープロセスの義務化: AIが生成したコードは、人間によるレビューを必須とする。

2. DevSecOpsパイプラインへの自動検証プロセスの組み込み

人間のレビューだけに依存せず、CI/CDパイプラインにAI生成コード向けの検証ステップを組み込みます。

静的/動的セキュリティテスト(SAST/DAST): 生成コードに対する脆弱性スキャンを自動実行する。

ソフトウェア構成分析(SCA): ライセンス違反や既知の脆弱性を持つコンポーネントの混入を自動で検知・ブロックする。

トレーサビリティの確保: どのコードがAIによって生成されたかをタグ付けし、問題発生時の原因究明と影響範囲の特定を迅速化します。

3. 開発者のスキルセットの変革

開発者に求められるスキルは、「ゼロからコードを書く能力」から、「AIに適切な指示(プロンプト)を出し、その生成物を批判的に評価・修正する能力」へとシフトします。この新たなスキルセットの獲得を、組織として支援・推進することが不可欠です。

結論:リスク管理こそが、競争優位の源泉となる

ソースコード生成AIは、正しく管理すれば、開発者の生産性を劇的に向上させ、より創造的な業務への集中を可能にします。しかし、その導入は技術的な問題だけでなく、品質保証とリスクマネジメントの新たな挑戦でもあります。

この挑戦に対し、データに基づいた客観的なリスク評価と、体系的なガバナンス体制をもって応えること。それこそが、生成AIがもたらす便益を真に享受し、持続的な競争優位を築くための鍵となるのです。

AI投資のROIを最大化するストレージ戦略:HDD/SSDの最適配置によるデータインフラの最適化

エグゼクティブサマリー

生成AIのビジネス実装が本格化する中、その性能とコスト効率を左右する根幹的な要素として、データストレージインフラの重要性が再定義されています。AIモデルのライフサイクル全体を見渡し、各フェーズの要求特性に応じたストレージを戦略的に配置することが、AI投資のROI(投資対効果)を最大化する鍵となります。

本稿の結論は明確です。AI時代のストレージ選定は、SSDかHDDかという二者択一の議論ではありません。AIワークロードの各ステージの特性に基づき、性能、容量、コスト(TCO)を最適化する「ハイブリッド構成」こそが唯一の正解です。本稿では、データライフサイクルに基づいた具体的なストレージ配置と、その背後にある定量的根拠を解説し、実践的な戦略を提言します。

課題:AIの性能はストレージのボトルネックに左右される

多くの企業がAI導入を進める中で、計算リソースであるGPUへの投資は優先される一方、ストレージインフラの最適化は見過ごされがちです。しかし、AIモデルの学習や推論において、ストレージのI/O(入出力)性能がボトルネックとなり、高価なGPUが遊休状態に陥るケースは少なくありません。AIプロジェクトの成功は、ストレージ戦略に大きく依存しているのです。

分析フレームワーク:「AIデータサイクル」に基づくストレージ要件の分解

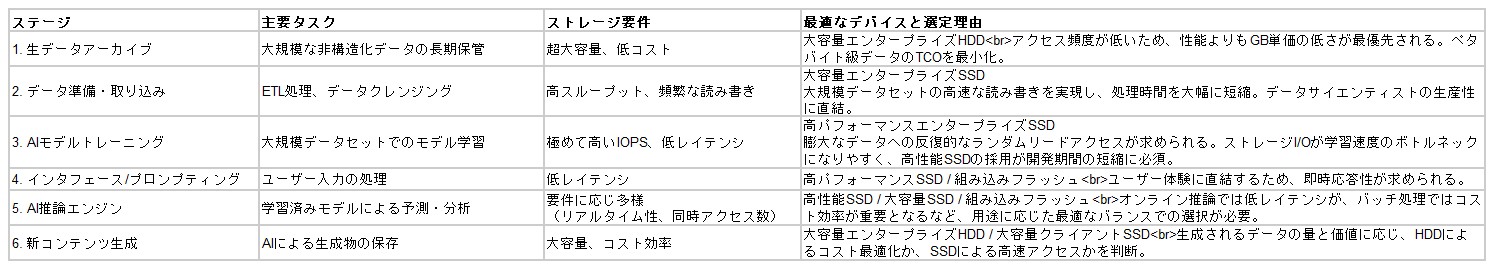

AIワークロードにおけるストレージ要件を理解する上で、「AIデータサイクル」は有効な分析フレームワークを提供します。これはAIモデルのライフサイクルを6つのステージに分解し、各々の要求特性を明確化するものです。

考察:TCO(総所有コスト)の視点に基づく意思決定

上記の分析が示すように、AIインフラにおけるストレージ選択は、性能要件(IOPS/スループット)、容量単価、そして電力効率や設置スペースといったTCOの構成要素を総合的に評価し、「適材適所」のハイブリッド構成を構築することが合理的です。

例えば、トレーニングサーバーにおける高性能SSDの採用は、初期導入コストこそHDDより高額です。しかし、モデル学習時間を数週間から数日へ短縮できれば、データサイエンティストの人件費、サーバー稼働の電力コスト、そして何よりも市場投入までの時間短縮(Time to Market)といったビジネスインパクトを考慮すると、TCOはむしろ劇的に低減されると評価できます。

2024年以降のストレージ需要回復は、このAI投資の本格化を背景とした構造的な変化です。AIモデルの大規模化は、学習データと生成データの両面でストレージ容量を爆発的に増大させ、高性能SSDと大容量HDD双方への需要を継続的に押し上げると予測されます。

提言:AI投資を成功に導く3つのアクション

AIのポテンシャルを最大限に引き出し、持続的な競争優位性を確保するため、以下の戦略的アクションを提言します。

ワークロードの定量的分析: 自社のAIプロジェクトにおけるデータフローを「AIデータサイクル」のようなフレームワークで可視化・分析します。各ステージでのI/O特性(データ量、アクセスパターン、IOPS/レイテンシ要件)を定量的に把握し、ボトルネックを特定することが全ての起点となります。

TCO主導のインフラ設計: 初期導入コストだけでなく、運用コスト(電力、冷却、ラックスペース)、パフォーマンス向上による機会創出(開発期間短縮、サービス品質向上)を含めたTCOシミュレーションに基づき、投資対効果を最大化するストレージ構成を設計します。

将来技術への戦略的投資: CXL(Compute Express Link)によるメモリとストレージの階層融合や、ストレージクラスメモリ(SCM)といった次世代技術の動向を注視し、将来のアーキテクチャ刷新を見据えたロードマップを策定します。これにより、インフラの硬直化を防ぎ、将来のイノベーションに迅速に対応可能な体制を構築します。

2025年 CIOが下すべきクラウド戦略:生成AIによる価値創出を最大化する次なる一手

エグゼクティブサマリー

2024年が生成AIの可能性を評価する「実験の年」であったならば、2025年はその投資を具体的な「ビジネス価値」へと転換する実行の年です。この変革の成否を分ける核心的な要素、それがクラウドの戦略的活用に他なりません。もはやクラウドは単なるITインフラではなく、ビジネスモデル変革と競争優位性構築のエンジンそのものです。

本稿では、データコンサルタントの視点から、CIOが2025年に注目すべきクラウドの動向を分析し、それが単なる技術トレンドではなく、いかにして企業の戦略的選択肢となりうるかを論じます。

現状分析:クラウドはAI活用の「自明の前提」である

生成AIの活用を議論する上で、クラウドは議論の余地なく、自明の前提となります。その理由は、大規模言語モデル(LLM)の学習と推論に要求される膨大な計算リソース、そして常に進化する最新モデルへのアクセス性は、クラウドが提供する圧倒的なスケールメリットとエコシステムに本質的に依存しているためです。

データセンターでのAI基盤構築という選択肢も理論上は存在しますが、現実的にはクラウド上のツールやサービスとのハイブリッド構成が不可避であり、クラウドを介さないアプローチは、極めて限定的なユースケースに留まります。

市場データが示す「不可逆な変化」と競争環境

このクラウドシフトは加速の一途をたどっています。市場予測によれば、世界のクラウド支出は2022年の約4,500億ドルから、2026年には約1兆ドル超へと倍増する見込みです。

この数値が示すのは、単なる市場の拡大ではありません。あらゆる業界の競合他社が、クラウドを前提としたビジネス変革を急ピッチで進めているという動態そのものです。もはやクラウド活用は選択肢の一つではなく、事業継続と成長のための必須要件と言えます。

2025年の最重要トレンド:クラウドネイティブAIサービスの進化と実装

2025年、CIOが最も注視すべきは、クラウドベンダーが提供する「クラウドネイティブAIサービス」の進化です。これは、単なる生成AIのAPI提供に留まるものではありません。データパイプライン、MLOps、ベクトルデータベースといった周辺技術群と高度に統合され、エンタープライズレベルのセキュリティとガバナンスを備えた、実用的なソリューションとして提供され始めています。

このトレンドがもたらす戦略的インパクトは絶大です。企業は、複雑なAIインフラの構築・運用という重労働から解放され、自社が保有する独自のデータという最も価値ある資産を活用し、競合との差別化に繋がるアプリケーション開発にリソースを集中投下できるようになります。

これにより、以下のような従来は困難であった価値創出が、現実的なものとなります。

ナレッジマネジメントの革新:

社内の議事録、技術文書、過去の問い合わせ履歴といった非構造化データをベクトル化し、RAG(Retrieval-Augmented Generation)アーキテクチャを実装。これにより、単なるキーワード検索ではない、文脈を理解した高精度なナレッジ検索システムを構築し、属人化していた知見を組織の資産へと転換し、全社的な生産性向上を実現します。

顧客エンゲージメントの高度化:

従来の受動的なチャットボットではなく、顧客の購買履歴やWeb上の行動データをリアルタイムで分析し、最適なタイミングでパーソナライズされた提案を行うプロアクティブなエージェントを開発。これにより、顧客体験を劇的に向上させ、LTV(顧客生涯価値)の最大化に貢献します。

リスク管理と事業継続性の強化:

サプライチェーン、金融取引、サイバーセキュリティログといった膨大なストリームデータをリアルタイムで監視・分析。統計的な異常検知を超え、AIが未知の脅威やリスクの予兆を特定し、事業インパクトを未然に防ぎます。

提言:CIOの役割は「価値創出のアーキテクト」へ

2024年、CIOに求められる役割は、テクノロジーの評価者から、ビジネス価値を創出するアーキテクトへと明確にシフトしています。生成AIとクラウドがもたらす変革の機会を捉え、どのビジネス課題に適用すればROIが最大化されるのかを見極め、全社的な変革をリードすることがミッションとなります。

クラウド戦略はもはやIT部門の専管事項ではなく、経営アジェンダそのものです。迅速な意思決定と実行のアジリティこそが、2025年の競争を勝ち抜くための唯一の鍵となるでしょう。

生成AIの価値を最大化する「RAG」と「ベクトル検索」:データサイロを克服し、信頼できるAIを実現する実践的アプローチ

エグゼクティブサマリー

生成AIを導入したものの、「自社の業務に関する専門的な質問に答えてくれない」「不正確な情報(ハルシネーション)を生成してしまう」といった課題に直面していないでしょうか。この問題の根源は、LLMがインターネット上の一般的な知識は持っていても、企業固有の非公開データや最新の業務ナレッジを知らないことにあります。

この「PoCの壁」を突破し、AIを真にビジネスに活用するための鍵として、RAG(Retrieval-Augmented Generation:検索拡張生成) というアーキテクチャが今、現実的な解決策として急速に普及しています。本稿では、RAGがなぜ有効なのか、その中核技術であるベクトル検索の役割、そしてRAGのポテンシャルを最大限に引き出すための根本的なデータ戦略について、データコンサルタントの視点から解説します。

1. RAG:LLMに「企業の頭脳」を外付けするアーキテクチャ

LLM自体に自社データを追加学習させるアプローチ(ファインチューニング)は、膨大な計算コストと時間を要する上、情報の鮮度を保ち続けることが困難です。

これに対しRAGは、LLMの外部に「信頼できる社内知識データベース」を構築し、ユーザーからの質問に応じて関連性の高い情報だけをその場で検索。その情報を基にLLMが回答を生成する、極めて効率的かつ実践的な手法です。これにより、以下の課題を解決します。

精度と信頼性の向上: 常に最新かつ正確な社内データを参照するため、ハルシネーションを劇的に抑制し、根拠に基づいた回答を生成します。

説明可能性の担保: AIがどの文書を基に回答したのか、その参照元を提示できるため、回答の正当性を検証可能です。

高度なセキュリティ: アクセス権限に基づいて参照させるデータソースを厳密に制御できるため、機密情報の漏洩リスクを最小化します。

2. ベクトル検索:RAGの性能を最大化する「意味」の検索技術

RAGの性能は、いかに的確な情報をデータベースから検索できるかに懸かっています。ここで中核的な役割を担うのがベクトル検索(セマンティック検索) です。

従来のキーワード検索が単語の文字列の一致を見るのに対し、ベクトル検索は単語や文章の「意味」を数値のベクトルとして捉え、意味的に近い情報を探し出します。これにより、「“契約不適合責任”について知りたい」という質問に対し、文書中にその言葉がなくても、「“瑕疵担保責任”の変更点」といった意味的に関連する文書を的確に提示することが可能になります。この「意味検索」能力こそが、AIの回答精度を飛躍的に高めるのです。

3. 根本課題:AI活用の成否を分ける「データサイロ」の克服

RAGとベクトル検索という強力な技術も、その土台となるデータが整備されていなければ真価を発揮できません。多くの企業において、データはオンプレミスのレガシーシステム、部門ごとに導入されたSaaS、マルチクラウド環境下の各種データストアに散在・分断された「データサイロ」 の状態にあります。このサイロこそが、全社横断的なAI活用を阻む最大の障壁です。

4. 提言:データファブリックによる論理的データ統合へ

この根深い課題に対し、我々は物理的なデータ統合(DWHへの画一的な集約)ではなく、データファブリックのようなモダンな論理的データ統合アプローチを提言します。

データファブリックは、データがどこに存在していても、それらを仮想的な一つのデータ層として扱えるようにするアーキテクチャです。これにより、組織はデータの実体を移動させることなく、統一されたポリシーに基づくデータガバナンス(アクセス制御、品質管理、データカタログ)を適用し、AIが必要とするデータをセキュアかつ迅速に提供することが可能になります。

結論:競争優位の源泉は「データをインテリジェンスに変換する能力」

現代のビジネスにおいて、真の競争優位はデータそのものではなく、組織内に散在するデータを迅速かつ的確にインテリジェンスへと変換する能力によってもたらされます。その能力を具体化するものが、まさにデータファブリックという統合基盤の上に構築された、RAGとベクトル検索を活用するAIアプリケーションなのです。

次なるステップ

「使えるAI」の実現に向け、以下のステップで着手することを推奨します。

データ資産の可視化と優先順位付け: まず、社内のデータ資産を棚卸しし、ビジネスインパクトの大きいドメイン(例:顧客サポート、ナレッジマネジメント)を特定します。

RAGのパイロット導入: 特定したドメインでRAGのパイロットプロジェクトを迅速に立ち上げ、その有効性とROIを実証します。

データ基盤のモダン化構想: パイロットと並行し、全社展開を見据えたデータファブリック/メッシュといった次世代データ基盤の構想策定に着手します。

AI時代のデータアーキテクチャ戦略:「データグラビティ」を制し、ハイブリッドAIの価値を最大化する

エグゼクティブサマリー

AI活用が本格化する現在、ITインフラの議論は「オンプレミスかクラウドか」という単純な二元論から、「どこで、どのデータを、どのように処理するか」という、より高度で複雑なアーキテクチャ設計の問題へとシフトしています。この問題の核心は、「データの物理的な制約(データグラビティ)」と「AIワークロードの多様な要求特性」との間に、いかにして最適なバランスを見出すかという点にあります。

本稿では、AIインフラにおける二つの潮流を分析し、データ移動に伴う物理的制約を乗り越えるための戦略的アプローチを提言します。結論から言えば、今後のAIアーキテクチャの成否は、「どのデータを動かし、どのデータを動かさないか」という戦略的意思決定にかかっています。

1. ハイブリッドAI:単なる過渡期ではなく、必然的なアーキテクチャ

現代のエンタープライズAIインフラは、集中型と分散型が混在するハイブリッド構成が標準です。これは単なる過渡的な形態ではなく、必然的な帰結と言えます。なぜなら、企業は「データガバナンスやセキュリティ要件からオンプレミスでの保持が必須な機密データ」と、「クラウドが提供するスケーラブルな計算リソースや最新AIサービスを活用したいという要求」の双方を、同時に満たす必要があるからです。このハイブリッドアプローチが、現実的かつ合理的な唯一の解となっています。

2. データ所在地のジレンマ:二つの対極的な潮流

このハイブリッド環境において、データとAIモデルの配置を巡る二つの対極的なアーキテクチャが存在します。

潮流①:データをAIに近づける(エッジAI / 分散型アプローチ)

データがシステムに分散したままでは効果的なAI活用は困難です。この課題に対する一つの解が、「データの発生源にAIモデルを配置する」エッジAIのアプローチです。

定義: 工場のセンサー、店舗のカメラ、自動車など、データが生成されるエッジデバイス上でAIのトレーニングや推論を実行するモデル。

戦略的メリット:

低遅延: データ転送が不要なため、リアルタイム性が要求される処理(例:工場の異常検知、自動運転の判断)に不可欠な即時応答性を確保します。

ネットワーク帯域の節約: 大量の生データをクラウドに送信する必要がなく、通信コストを大幅に削減します。

事業継続性: クラウドとの接続が途絶えても、エッジ側で自律的にAI処理を継続可能です。

潮流②:AIにデータを近づける(集中型LLM / クラウド集約アプローチ)

一方で、生成AI、特に大規模言語モデル(LLM)の登場は、これとは逆の潮流を加速させました。LLMのような巨大モデルは、特定のクラウド環境やデータセンターにホストされているため、学習や推論のためには、企業のデータをそこに集約させる必要があります。

定義: 各所から収集したデータを、LLMが稼働する中央のプラットフォームに移動させ、処理を行うモデル。

戦略的メリット:

高度な分析能力: 組織全体の膨大なデータを組み合わせ、巨大なAIモデルで処理することで、単一のデータソースからでは得られない、高度で広範な洞察(例:全社横断ナレッジ検索、大規模市場分析)を引き出します。

最新モデルへのアクセス: クラウドベンダーが提供する最先端のAIモデルを、自社のデータに迅速に適用できます。

3. 物理的制約:「データグラビティ」との戦い

この二つの潮流の狭間で顕在化するのが、「データ移動」という根源的な課題です。我々はこれを「データグラビティ(データの引力)」と呼びます。データは、その量が増えるほど移動が困難になり、特定の場所に留まろうとする物理的制約です。このデータグラビティが、ビジネスに以下の深刻なリスクをもたらします。

コスト(機会損失を含む): 大量データの移動には、通信・ストレージ費用だけでなく、多大な時間も要します。この時間は、迅速な意思決定が求められるビジネスにおいて、致命的な「機会損失」という見えないコストに直結します。

データ一貫性とDR(災害復旧): クラウドとオンプレミス間でデータのバージョンに不整合が生じると、古いデータや誤ったデータに基づくAIの判断を誘発し、企業の信頼を揺るがすビジネスリスクに繋がりかねません。

低遅延(顧客体験の品質): 金融取引やスマートビークルはもちろんのこと、あらゆるリアルタイムインタラクションにおいて、データ移動に伴う遅延は、顧客体験の質を直接的に低下させる要因となります。

提言:ユースケース主導のデータアーキテクチャ設計へ

画一的な正解は存在しません。2025年以降のAIアーキテクチャ戦略の核心は、ユースケースごとに最適なデータ配置と処理アーキテクチャを設計することです。そのための戦略的ステップを以下に示します。

データ資産の分類と評価: まず、自社のデータ資産を「鮮度(リアルタイム性)」「機密度」「量」「ビジネス価値」といった軸で分類し、データグラビティの影響度を定量的に評価します。

ワークロード特性に基づくアーキテクチャ選択: AIのユースケースごとに、求められる応答時間、処理データ量、モデルサイズを定義し、エッジでの分散処理が最適か、クラウドへの集約処理が最適かを判断します。

論理的データプレーンの構築: オンプレミス、マルチクラウド、エッジにまたがるデータを、物理的な場所を意識させずに、統一されたポリシーで管理・アクセスできる「論理的なデータプレーン(データファブリックなど)」の構築を検討します。これこそが、データグラビティの制約を乗り越え、ハイブリッドAIの俊敏性と柔軟性を最大化するための鍵となります。